Alberto Broggi, Direttore Generale di Vislab, società del gruppo Ambarella nata come spin-off dell’Università di Parma.

Per capire l’evoluzione di una tecnologia è meglio sentire gli esperti. Se si vuole sapere in quale direzione stia andando l’auto autonoma, bisogna parlare con Alberto Broggi, fondatore di Vislab, spin-off acquisita nel 2015 dal Gruppo Ambarella.

di Riccardo Oldani

Era l’inizio del mese di giugno del 1998 quando una Lancia Thema grigia partì da Parma per percorrere i quasi 2.000 km del percorso della Mille Miglia, la più eroica gara automobilistica d’Italia e una tra le più famose del pianeta. Nel giro di sei giorni la berlina completò con successo il tour, che passò da Torino e Pavia, toccò Ferrara e Bologna, scese fino a ad Ancona, Pescara e Roma e riprese la via del ritorno attraversando Firenze e, di nuovo Bologna. La particolarità di quell’impresa? Per il 94% del tragitto nessuno toccò il volante, perché quella vettura, battezzata Argo, era il primo prototipo italiano di auto a guida autonoma.

Argo, la Lancia Thema modificata da Vislab che nel 1998 percorse lunghi tratti dei quasi 2.000 km della Mille Miglia in modalità di guida autonoma.

IMPRESE DA PIONIERI

“Facemmo la nostra Mille Miglia a una velocità media di 90 km/h, e con tratti di guida in modalità automatica lunghi anche oltre 50 km, intervallati da altri in cui la tecnologia di allora ci imponeva di riprendere momentaneamente il controllo dell’auto”, ricorda Alberto Broggi, l’ideatore di quel primo, pionieristico progetto, e il fondatore di Vislab, il laboratorio dell’Università di Parma che sviluppò Argo. A quell’impresa ne seguirono altre. I veicoli sperimentali a guida autonoma messi a punto dal team italiano hanno attraversato il deserto del Nevada, compiuto un viaggio dall’Italia a Shanghai e sono stati i primi al mondo, nel 2013, a destreggiarsi in un percorso senza autista all’interno di una città, nel centro di Parma.

La ricerca di Vislab è incentrata sulle tecnologie di percezione delle auto a guida autonoma e sull’elaborazione dei dati raccolti per trasformarli in input al veicolo.

DALLA RICERCA AI MICROPROCESSORI

Grazie a questi record, Vislab, che era nato come centro di ricerca sulle tecnologie della visione artificiale e della percezione, si è segnalato tra i pionieri mondiali delle tecnologie per la guida autonoma. Al punto che, nel 2015, il gruppo statunitense Ambarella lo ha acquisito per avvalersi della sua ricerca, lasciando però scienziati e strutture in Italia.

Ambarella sviluppa microprocessori su misura per applicazioni basate su tecnologie avanzate e sull’intelligenza artificiale. Grazie al contributo fornito da Vislab, l’azienda californiana ha realizzato una serie di microprocessori per governare e gestire i sistemi ADAS, quelli cioè che garantiscono l’assistenza avanzata di guida indispensabile per le auto autonome. Alcuni sono già impiegati per governare aspetti parziali della guida autonoma. Ma l’ultimo arrivato, il CV3, può consentire ai costruttori di realizzare auto autonome di livello 4. Nella scala che definisce i vari gradi di guida autonoma, da L0 a L5, quello ottenibile con il nuovo microprocessore corrisponde pertanto alla “guida pienamente automatizzata”, in cui il conducente può disinteressarsi completamente del veicolo, e se questo si “rende conto” di non potere per qualche motivo raggiungere la meta prefissata, deve essere in grado di rallentare e parcheggiarsi in piena sicurezza e senza intervento umano.

PORTE APERTE

Nel venticinquesimo anniversario della Mille Miglia in Automatico, Vislab e Alberto Broggi ci hanno invitati a un confronto sugli sviluppi e il futuro della guida autonoma. Un’occasione anche per vedere con i nostri occhi i passi da gigante compiuti dalla tecnologia. L’ultima volta che avevamo osservato da vicino un’auto autonoma di Vislab, la Deeva, versione modificata di una berlina Audi di grandi dimensioni, le prestazioni erano già stupefacenti. Ma i computer di bordo necessari per elaborare in tempo reale tutti i dati raccolti dalle telecamere e dal radar installati sul veicolo occupavano l’intero baule. Ora, nei prototipi più recenti il microprocessore CV3 montato a bordo è in grado di svolgere le funzioni della maggior parte di quella vecchia strumentazione. Tutto l’hardware per l’elaborazione dei dati e la loro traduzione in input per la vettura è alloggiato in un contenitore non più grande di due scatole da scarpe.

VISIONE E RADAR INSIEME

Ma che cosa ha portato a questo miglioramento? “Tutto nasce”, dice Broggi, “dalla strategia che abbiamo scelto per gestire la percezione dell’ambiente intorno all’auto in movimento: quindi la raccolta delle immagini e l’acquisizione e l’utilizzo dei dati. Noi abbiamo optato per utilizzare visione e radar, che si integrano molto bene tra loro. Altri hanno puntato sul Lidar, che però ha il limite, come le telecamere tradizionali, di non essere efficace in condizioni di meteo avverso. Il suo principale vantaggio consiste nella capacità di stimare con precisione la distanza con un ostacolo anche al buio, utile in fase di parcheggio o nelle curve strette. Ma in queste situazioni si possono anche usare, come abbiamo fatto noi, led laterali per illuminare le aree di interesse e rendere così possibile l’impiego di semplici telecamere”.

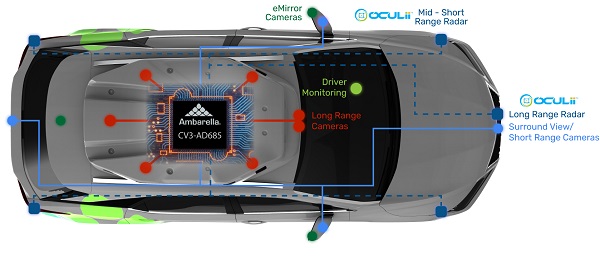

Nelle vetture sperimentali di Ambarella il radar è installato nei paraurti e le telecamere sono integrate in una decina di punti nella carrozzeria. Alcune, come quella frontale e quelle laterali, sono accoppiate per avere una visione stereoscopica e, quindi, tridimensionale.

“La scelta di utilizzare telecamere e radar è stata dettata dall’obiettivo di ottenere una mappatura quanto più dettagliata dell’ambiente in cui si muove l’auto”, spiega Broggi. “Immagini e dati radar vengono subito trattati a bordo tramite una ‘fusione a basso livello’, da cui otteniamo una densità di informazioni molto elevata e, di conseguenza, una classificazione dei punti e degli oggetti estremamente completa. La potenza di calcolo necessaria a questa fusione è fornita dal nostro microprocessore e porta alla creazione di una mappa estremamente precisa, che si aggiorna in tempo reale, consentendo di misurare con precisione le distanze tra il veicolo e soggetti in movimento, anche quando questi si possono confondere con lo sfondo. Il mix tra telecamere e radar ci permette poi di raccogliere per ogni oggetto un numero di pixel molto superiore rispetto a quanto farebbe il Lidar, e quindi di ottenere una rappresentazione dello scenario molto più aderente alla realtà”.

Per curare ancora più nel dettaglio l’aspetto della mappatura, Ambarella ha acquisito di recente un’azienda dell’Ohio, Oculii, esperta nello sviluppo di software per l’analisi dei dati radar.

La dislocazione di telecamere e radar sui veicoli Vislab e le funzioni eseguite dal chip CV3 sviluppato da Ambarella.

PRIMA VIENE L’ALGORITMO

Una volta raccolto un set di dati ambientali consistente, preciso e ricco di informazioni, occorre elaborarlo in tempo reale a bordo del veicolo per tradurlo istantaneamente in istruzioni di guida. Anche in questo caso sono stati compiuti passi da gigante. Lo abbiamo visto con il passaggio dal baule pieno di PC e di cavi della Deeva del 2014 allo scatolino installato sugli ultimi modelli. “La potenza richiesta per alimentare l’hardware che usavamo sulla Deeva”, osserva, “era di 5 kW, oggi con il nostro chip è di 60 W di picco. A bordo installiamo due di questi microprocessori, ma solo uno viene utilizzato. L’altro è ridondante. Il raffreddamento è ad aria, quindi estremamente efficiente e semplice, decisamente più facile da gestire di altre soluzioni che abbiamo visto applicate in altri progetti di auto autonome, basate sul raffreddamento a liquido”.

Questa efficienza del microprocessore è figlia di un preciso approccio seguito da Ambarella, quello dell’“algorithm first design”. “Significa”, dice Broggi, “che prima realizziamo l’algoritmo in grado di svolgere le funzioni richieste dalla specifica applicazione e poi, una volta che lo abbiamo verificato e testato, progettiamo il chip su misura per gestire tutte le operazioni di calcolo”. Nel caso della guida autonoma non si tratta solo di realizzare la fusione a basso livello dei dati video e radar, ma anche d’interpretare questi dati con tecniche di machine learning, che richiedono l’impiego di reti neurali. Queste funzioni sono svolte da un’area del microprocessore CV3, denominata CV Flow, a cui è delegata la parte di deep learning, che consente di riconoscere gli ostacoli, classificarli, tracciarli e seguirli nello spazio.

I DATI FANNO LA DIFFERENZA

Ma c’è di più. “La nostra strategia che parte dall’algoritmo per arrivare al microprocessore ha successo anche perché i set di dati con cui viene addestrata tutta la parte di deep learning sono affidabili e attendibili. Si tratta infatti di dati generati e controllati interamente da noi, da tutto il lavoro di ricerca e sul campo che abbiamo condotto e accumulato negli anni. In effetti, il successo e l’efficacia dei sistemi di deep learning, definizione che preferisco a quella di intelligenza artificiale, dipende molto strettamente dai dati. La parte intelligente di questi sistemi non sta solo nell’hardware, ma soprattutto nei dataset, che sono la vera ricchezza su cui ci si giocherà il vantaggio competitivo nelle varie applicazioni, guida autonoma compresa”, afferma Broggi.

SCELTE SULLE MAPPE

La capacità di calcolo a bordo dei veicoli a guida autonoma di Vislab ha consentito anche una scelta strategica per quanto riguarda le mappe utilizzate. “Una strategia impiegata da altri player consiste nell’utilizzare mappe ad altissima risoluzione, con il dettaglio di tutti gli elementi fissi come marciapiedi, semafori, spartitraffico e simili. Si caricano in memoria e il veicolo, procedendo, grazie al gps individua la propria posizione su queste mappe. Anche noi inizialmente le abbiamo usate, ma poi abbiamo preferito un altro approccio. Impieghiamo mappe topologiche, più semplificate, a cui si integrano i dati in alta risoluzione che produciamo ‘on the fly’, sul momento, con telecamere e radar. Questo ci consente di evitare i problemi legati alle mappe HD precaricate, che non sono disponibili in tutto il mondo e soprattutto non vengono aggiornate in tempo reale se viene modificata la viabilità, aperto un cantiere stradale o, semplicemente, chiusa una strada. Noi abbiamo puntato tutto sull’estrema affidabilità della percezione, e una volta che l’abbiamo ottenuta non abbiamo bisogno di mappe ad alta risoluzione”, sottolinea Broggi.

Il contenitore che alloggia tutto l’hardware necessario alle funzioni di guida autonoma sui nuovi prototipi di Vislab.

PROVA SU STRADA

Alla luce di tutte queste informazioni abbiamo fatto un bel giro in auto per verificare il funzionamento del sistema. La legge italiana impone che, in ogni caso, nelle auto a guida autonoma una persona stia sempre seduta al volante, pronta a prendere i comandi in caso di bisogno. Ma in tutto il giro di una ventina di minuti fatto intorno alla sede di Vislab, tra rotonde, accessi in tangenziale e centri commerciali, non c’è stato bisogno di alcun intervento umano. Qualche difficoltà è emersa nel caso delle immissioni in rotonda, più che altro perché gli automobilisti umani tendono a essere un po’ troppo indisciplinati in questi tratti stradali. Ma alla fine l’auto che ci ha scarrozzato se l’è cavata più che bene.

In particolare, in fase di parcheggio. Entrati in un’area di sosta a pettine, il sistema ha segnalato a voce che cosa stava per fare con un messaggio del tipo: “Ho individuato un posteggio, inizio la manovra”. Con un solo giro di volante e una marcia indietro il veicolo si è infilato alla perfezione nello spazio tra due auto già posteggiate. Durante la marcia abbiamo per la verità avvertito qualche scossone, dovuto a accelerazioni e frenate un po’ brusche, ma ci è stato assicurato che si trattava di un semplice problema di taratura facilmente risolvibile. Alla fine del giro l’impressione è stata notevole ed è parso chiaro che l’auto a guida autonoma di Vislab sia già sostanzialmente pronta a girare su strada e che la tecnologia è pronta. Manca soltanto la messa a punto di qualche particolare.

LE SFIDE APERTE

Anche di questo abbiamo parlato con Alberto Broggi. Quali sono i limiti ancora da superare? “Dal punto di vista del software”, ci ha risposto Broggi, “ci pare ancora molto complicato risolvere in modo univoco situazioni impreviste come, per esempio, il superamento di tratti con lavori in corso. Nel mondo sono troppo eterogenee le soluzioni adottate per segnalarli, dalla segnaletica verticale a quella orizzontale, per cui la gestione di queste situazioni al momento viene affrontata con soluzioni ancora elementari. Ma qui si innesta anche un altro discorso, quello delle ‘culture’ di guida. In ogni Paese, ma direi anche in ogni città, gli automobilisti si comportano in modi diversi e hanno sviluppato una capacità reciproca di comprendersi che aiuta a evitare incidenti. Un’auto a guida autonoma come potrebbe adattarsi a queste differenti abitudini tipiche di un territorio? Al momento questo problema è ancora in fase di studio”.

Un’altra sfida è quella dell’hardware. Come abbiamo visto occorre una grande potenza di calcolo per gestire la guida autonoma. Lo sviluppo da parte di Ambarella del suo microprocessore CV3 e di altri prodotti della stessa linea risponde già all’esigenza di ridurre i consumi energetici, ma altre soluzioni attualmente in fase di test sono estremamente energivore. Anche la ridondanza dei sistemi, fondamentale per motivi di sicurezza, perché l’auto a guida autonoma non può mai smettere di funzionare, pone problemi ancora da affrontare in tutte le loro sfaccettature.

SFATARE I FALSI MITI

Altri problemi su cui da sempre si dibatte riguardo alla guida autonoma in realtà, secondo Broggi, sono falsi miti. Per esempio, c’è chi sostiene che i sistemi di guida autonoma richiedono una connessione in tempo reale raggiungibile soltanto con il 5G. Necessaria, si dice, per connettere in un’unica rete tutti i veicoli autonomi e gestirli in modo sicuro. “Dal mio punto di vista”, osserva Broggi, “in realtà la connessione non è necessaria. Se c’è e se può essere utilizzata, tanto meglio, ma non deve avere alcuna funzione durante la guida. I veicoli autonomi devono essere autonomi veramente, non dipendere dalla stabilità di una connessione esterna”.

Altri temi riguardano le decisioni morali che le auto dovrebbero prendere in situazioni al limite. Su questo aspetto molti esperti hanno provato a immaginare casi particolari, etichettati come “trolley problem” da una definizione data loro negli anni Settanta. All’epoca si immaginava un tram in corsa diretto verso un gruppo di persone destinate a essere investite e uccise. Ma azionando uno scambio sarebbe stato possibile deviare il mezzo su un binario su cui avrebbe colpito solo una persona. In situazioni di questo genere sarebbe etico intervenire o si dovrebbe lasciare il destino compiere il suo corso?

Il sistema misto di telecamere e radar usato da Vislab consente di creare “on the fly” mappe estremamente dettagliate dell’ambiente.

IL SENSO DELLE SCELTE ETICHE

Trasposto all’ambito dell’auto autonoma, il trolley problem ha assunto infinite varianti: il sistema di guida che cosa dovrebbe scegliere di fronte al dilemma se investire un adulto o un bambino? Sarebbe in grado di distinguere tra una persona e un manichino e quindi investire quest’ultimo? Potrebbe capire se una donna è incinta e in questo caso risparmiare lei e il nascituro per colpire invece un altro sfortunato passante? “Il punto debole di questi esercizi teorici”, osserva Broggi su questo punto, “è che le soluzioni prospettate per questi problemi etici si riducono sempre a due sole alternative. Ma la realtà è sempre più complessa, e le alternative possibili sono infinite. E poi il sistema di percezione delle auto a guida autonoma non è giunto a un livello di precisione tale da cogliere tutti i distinguo introdotti in questi casi studio. Che, quindi, al momento, non hanno molto senso”.

E qual è la risposta a chi teme che sarà l’intelligenza artificiale a guidare le auto con il rischio, quindi, che un’entità esterna, non umana, prenda il controllo delle nostre vite? “La risposta”, conclude Broggi, “è che anche questo mito della guida autonoma è mal posto. L’intelligenza artificiale, se vogliamo chiamarla così, è comunque addestrata da persone sulla base di set di dati individuati e selezionati dalle persone. Quindi, a ben guardare, non esiste di fatto un’intelligenza artificiale, ma l’intelligenza della persona che ha curato l’addestramento del sistema di deep learning”.

UN MICROPROCESSORE NATO DALLA RICERCA

La famiglia di microprocessori CV3-AD sviluppati da Ambarella nasce dall’intenso lavoro compiuto negli anni dai ricercatori di Vislab, che oggi conta circa un’ottantina di persone nel suo organico ed è in continua crescita. Il CV3 è un “system on chip” (SoC) con una potenza di calcolo 40 volte superiore ai modelli precedenti, ed è in grado di analizzare le immagini video in modo estremamente dettagliato, per esempio anche in condizioni di luce o di contrasto difficili, assicurando la registrazione e lo streaming di immagini ad alta risoluzione con bit rate molto bassi e un’elevata efficienza energetica. È anche dotato di funzioni di cybersecurity.

Ambarella indica questo chip come ideale per veicoli a guida autonoma tra i livelli L2+ e L4, per gestire sistemi ADAS multicamera, assistenza al parcheggio, sistemi di monitoraggio della guida e anche specchi elettronici per eliminare i punti ciechi.

Per la navigazione Vislab ha scelto di basarsi su mappe topologiche (foto a sinistra) rispetto a quelle ad alta risoluzione (foto a destra) che richiedono aggiornamenti più frequenti.